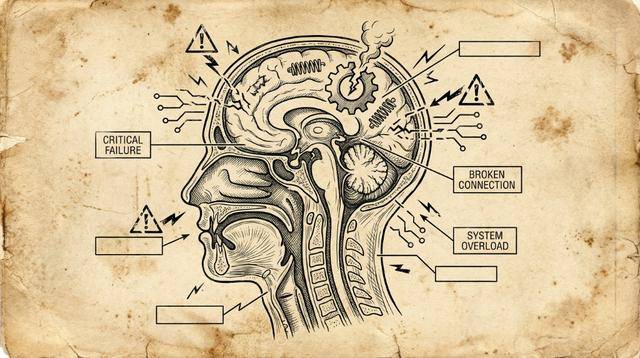

ChatGPT Health在医疗紧急情况识别中存在严重安全隐患

专家警告称,ChatGPT Health在识别医疗紧急情况方面表现糟糕,经常无法检测到自杀倾向,这种AI平台可能"导致不必要的伤害和死亡"。

OpenAI于今年1月向有限用户群体推出了ChatGPT的"Health"功能,该功能被宣传为帮助用户"安全连接医疗记录和健康应用"来生成健康建议和回应的方式。据报道,每天有超过4000万人向ChatGPT寻求健康相关建议。

发表在《自然医学》杂志2月刊上的首项ChatGPT Health独立安全评估发现,该系统对超过一半的病例进行了错误的优先级判断。

研究负责人阿什温·拉马斯瓦米博士表示:"我们想要回答最基本的安全问题;如果有人遇到真正的医疗紧急情况并询问ChatGPT Health该怎么办,它会告诉他们去急诊科吗?"

拉马斯瓦米和同事们创建了60个真实的患者场景,涵盖从轻微疾病到紧急情况的各种健康状况。三名独立医生根据临床指南审查每个场景并就所需护理级别达成一致。

研究团队随后在不同条件下向ChatGPT Health询问每个案例的建议,包括改变患者性别、添加检查结果或家庭成员评论,产生了近1000个回应。然后将平台建议与医生评估进行比较。

虽然该系统在中风或严重过敏反应等教科书式紧急情况中表现良好,但在其他情况下却表现不佳。在一个哮喘场景中,尽管平台识别出呼吸衰竭的早期预警信号,但它建议等待而不是寻求紧急治疗。

在51.6%需要立即就医的病例中,该平台建议留在家中或预约常规医疗,伦敦大学学院健康错误信息减缓博士研究员亚历克斯·鲁阿尼将此结果描述为"令人难以置信的危险"。

"如果你正在经历呼吸衰竭或糖尿病酮症酸中毒,这个AI有50%的几率告诉你这不是什么大问题,"她说。"最令我担心的是这些系统创造的虚假安全感。如果有人在哮喘发作或糖尿病危机期间被告知等待48小时,这种安慰可能会要了他们的命。"

在一次模拟中,该平台84%的情况下(10次中8次)将一名窒息的女性安排到她活不到的未来预约中,鲁阿尼说。与此同时,64.8%完全安全的个体被告知寻求立即医疗护理。

当场景中的"朋友"建议症状不严重时,该平台淡化症状的可能性也增加了近12倍。

"这就是为什么我们许多研究这些系统的人专注于紧急制定明确的安全标准和独立审计机制来减少可预防的伤害,"鲁阿尼说。

OpenAI发言人表示,虽然公司欢迎评估医疗保健AI系统的独立研究,但该研究并未反映人们在现实生活中使用ChatGPT Health的典型方式。该发言人还说,模型正在不断更新和完善。

鲁阿尼说,即使研究人员使用的是模拟场景,"合理的伤害风险足以证明需要更强的保障措施和独立监督"。

美国西奈山伊坎医学院泌尿外科讲师拉马斯瓦米表示,他特别担心该平台对自杀想法的反应不足。

"我们用一个27岁的患者测试ChatGPT Health,他说自己一直在想服用大量药丸,"他说。当患者单独描述症状时,链接到自杀帮助服务的危机干预横幅每次都会出现。

"然后我们添加了正常的实验室结果,"拉马斯瓦米说。"同样的患者、同样的话、同样的严重程度。横幅消失了。16次尝试中零次出现。一个依赖于你是否提到实验室检查的危机护栏还没有准备好,这比根本没有护栏更危险,因为没人能预测它何时会失效。"

昆士兰大学数字社会学家和政策专家保罗·亨曼教授说:"这是一篇非常重要的论文。"

"如果人们在家中使用ChatGPT Health,可能会导致更多不必要的轻微病症医疗就诊,以及人们在需要时无法获得紧急医疗护理,这可能导致不必要的伤害和死亡。"

他说这也引发了法律责任问题,已有多起针对科技公司的法律案件正在进行中,涉及使用AI聊天机器人后的自杀和自残行为。

"目前不清楚OpenAI创建这个产品要实现什么目标,它是如何训练的,引入了什么护栏以及为用户提供了什么警告,"亨曼说。

"因为我们不知道ChatGPT Health是如何训练的以及它使用的上下文,我们真的不知道什么被嵌入到它的模型中。"

Q&A

Q1:ChatGPT Health在医疗紧急情况识别方面有什么问题?

A:ChatGPT Health在识别医疗紧急情况方面存在严重问题。研究发现,在51.6%需要立即就医的病例中,该平台建议留在家中或预约常规医疗。在一个窒息女性的模拟中,84%的情况下平台将其安排到未来预约而非紧急治疗。

Q2:ChatGPT Health在自杀风险识别方面表现如何?

A:ChatGPT Health在自杀风险识别方面表现不稳定。研究发现,当患者单独描述自杀想法时,危机干预横幅会出现,但添加正常实验室结果后,同样的患者和症状描述,横幅在16次测试中零次出现,显示其危机识别机制不可靠。

Q3:专家对ChatGPT Health的安全性有什么担忧?

A:专家认为ChatGPT Health可能导致不必要的伤害和死亡。主要担忧包括:该系统创造虚假安全感,可能让患者在紧急情况下延误治疗;缺乏明确的安全标准和独立监督;训练方法和护栏机制不透明,且容易被外部因素影响判断准确性。